تکنولوژی دیپ نوستالژی سر و صدای زیادی به پا کرده است. Deep Nostalgia در اصل یک برنامه قدرت گرفته از هوش مصنوعی است که گذشته را زنده کرده است.

توضیح دادن حجم احساساتی که بعد از دیدن عکس قدیمی یکی از عزیزانمان به ما دست میدهد، غیرقابل توصیف است. درحالی که به نحوی چشمک میزند و سر خود را تکان میدهد که انگار همین دیروز عکس گرفته است و سالها پیش یعنی قبل از اینکه فیلمبرداری به کاری عادی تبدیل شود از دنیا نرفته است.

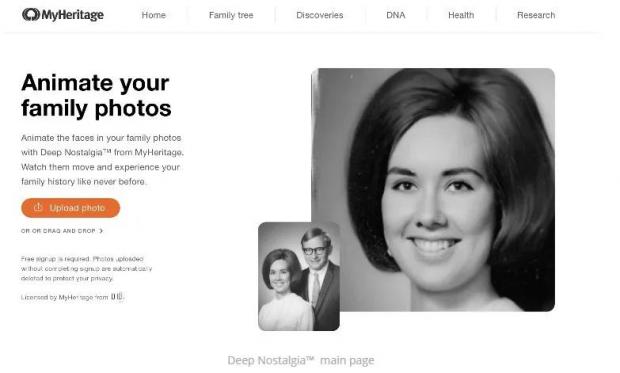

این تصاویر متحرک که در بیننده احساساتی هیجانانگیز و ناراحت کننده ایجاد میکند به وسیله یک برنامه هوش مصنوعی بهنام دیپ نوستالژی (Deep Nostalgia) ساخته میشوند که از پلتفرمهای مای هریتج (MyHeritage) آمده است.

همه چیز در مورد تکنولوژی دیپ فیک در اپلیکیشن دیپ نوستالژی

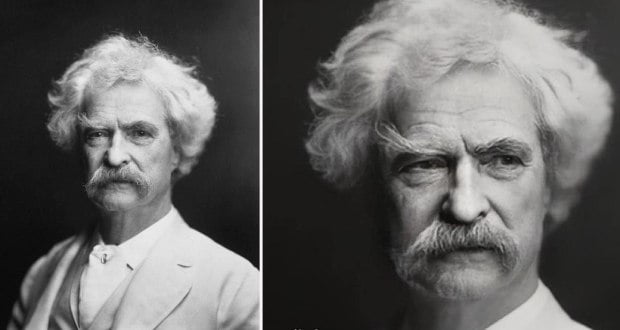

فناوری ساخت این تصاویر با هوش مصنوعی پیچیده و دشوار نیست. در این برنامه از کاربران تقاضا میشود تا عکسهای قدیمی افراد دلخواهشان را ارائه کنند تا این برنامه با استفاده از یادگیری عمیق حرکاتی از پیش تعیین شده روی بخشهای صورت آنها اعمال کند.

برنامه مذکور همچنین لحظاتی که در تصویر اصلی ثبت نشدهاند را مانند لبخند با دندانهای پیدا و بخشهای کناری سر را نیز به وجود میآورد و تمام این موارد باعث ایجاد تصویری میشوند که شاید طبیعی به نظر نرسند؛ اما بر بیننده تأثیر زیادی میگذارند. عکسالعمل بیننده با دیدن این تصاویر میتواند ریختن اشک باشد و یا احساس عجیبی به وی دست دهد.

هینی فرید (Hany Farid) مدیر دانشکده اطلاعات دانشگاه بروکلی (Berkeley) در ارتباط با این موضوع اظهار میکند که زمانی که ما مادربزرگ یا پدربزرگ خود را زنده میبینیم احساس شگفتانگیزی به ما دست میدهد که البته مقدار چاشنی ترس نیز با آن همراه است. مغز پیچیده ما به چیزهایی که شبیه انسان هستند؛ اما انسان نیستند واکنش نشان میدهد. این واکنش با نام دره وهمی (Uncanny Valley) شناخته میشود و تصاویری که توسط هوش مصنوعی ساخته شدهاند باعث فعال شدن زنگ خطر مغز میشوند.

حتی برنامه MyHeritage در رابطه با این موضوع توضیحی ارائه کرده و نوشته است که اگرچه نتایج میتواند بحثبرانگیز باشد و دشوار است که نسبت به این فناوری بیتفاوت باشیم؛ اما زمانی که یکی از نزدیکان ما در محیطی کمی واقعی قرار میگیرند هر دو بخش مغز ما یعنی ترس و عشق فعال میشوند، حتی اگر ما آگاه باشیم که چیزی که یه آن نگاه میکنیم واقعیت ندارد. مغز ما تصاویر افراد را نسبت به اشیاء بیجان متفاوت پردازش میکند و این موضوع در شبکه عصبیما صورت میگیرد.

لا مار جورل بروس (La Marr Jurelle Bruce) استاد دانشگاه مریلند که تصویری متحرک از فردریک داگلاس که یکی از رهبران بزرگ ضد برده داری آمریکا بود به اشتراک گذاشت و توجه افراد زیادی را به آن جلب کرد عنوان می کند که احساس شگفتی من با مقداری چاشنی ترس همراه بود.

دیپ فیکها (Deepfakes) ها که ترکیبی از تصاویر و صدا هستند برای سالها مورد بحث اخلاقگرایان در حوزه دیجیتال بودهاند، مخصوصا وقتی که این ابزار برای ساخت فیلمهای جعلی و هرزه نگاری مورد استفاده قرار بگیرد میتواند مؤسسات ملی و مالی را با تهدید جدی مواجه کند.

این ماجرا زمانی خطرناک میشود که فناور دیپ فیک به حدی پیشرفت کند که بشود از آن سوء استفادههای کلان کرد و حتی شاید روزی موضوع احراز هویت را نیز به یک شوخی تبدیل کند.

برای استفاده درست و مثبت از این فناوری شرکتها از آن برای ساخت کمپینهای تبلیغاتی استفاده می کنند که برای افراد شخصیسازی شده است. طبق گفته متخصصان بازده تبلیغات زمانی افزایش پیدا میکند که مصرف کننده با آن برند یا محصول ارتباطی بیشتری برقرار کند و ببیند که آن محصول تأثیر خاصی بر زندگیاش میگذارد و مدلی شبیه به خودش و زبان خودش آن را به نمایش در میاورد. برنامه های این چنینی ارتباطی شبیه به نوستالژی عمیق به وجود میاورند؛ اما در اصل هیچ چیز انسانی در هوش مصنوعی وجود ندارد.

فرید معتقد است که یادگیری ماشینی که موجب گسترش فناوریهای متحرک ساز میشود مانند فناوری نوستالژی عمیق بخش از دنیای وسیع هوش مصنوعی است. یادگیری ماشینی داده ها را با دقت مورد بررسی قرار میدهد و الگوها را مییابد. در حالی که یک برنامه از طریق دریافت اطلاعات بیشتر می تواند پیشرفت کند؛ اما در نحوه استفاده از این الگوها هیچ هوش یا تجزیه و تحلیلی وجود ندارد. اپلکیشنهای زیادی وجود دارند که از این دادهها سودهای کلانی میبرند.

ایجاد گرافیک رایانهای هوشهای مصنوعی از صورت انسانها یکی دیگر از خطراتی است که امنیت ما را در فضای مجازی تهدید می کند، اگرچه بعضی اوقات هم ایرادات آن هنگامی که نمیداند با بخش های غیر عادی مانند عینک و گوشها خنده دار است و حتی در پیچیدهترین دیپ فیکها مانند دیپ فیک تام کروز (Tom Cruise) هم تناقضهای جزئی وجود دارد که موجب میشود تا به واقعی بودن آن شک کنیم. با این وجود این این ایرادات جزئی با پیشرفت این فناوری مرتفع میشوند و فرید میگوید که اکنون زمان آن رسیده تا شرکتها پیامدهای اخلاقی فناوری دیپ نوستالژی را مورد نقد قرار دهند و ما باید از ساختن چنین فناوریهایی جلوگیری کنیم و در مورد آنها سؤال کنیم قبل از آن که دیر شود.

فرد حاضر در ویدئو بالا تام کروز نیست و توسط دیپ فیک ساخته شده است

برنامه دیپ نوستالژی قبل از استفاده به افراد در ارتباط با استفاده غیرقانونی و بدون اجازه از عکس دیگران هشدار می دهد و میگوید برای حفظ امنیت افراد این شرکت گزینه افزوده صدا به تصویر را در نظر نگرفته است.

شاید این برنامه در آینده خللهای مذکور را پر کند تا ما بتوانیم افرادی که سالهاست آنها را ندیده ایم ببینیم و با آنها صحبت کنیم. چنین فناوری چالشهای فراوانی را در برابر امنیت و باورپذیری تجربه خواهد کرد؛ اما زمانی که ما میبینیم کسانی که دوستشان داریم به ما لبخند میزنند نمیتوانیم در برابر این فناوری مقاومت کنیم.

گجت نیوز آخرین اخبار تکنولوژی، علم و خودرو

گجت نیوز آخرین اخبار تکنولوژی، علم و خودرو