گزارشی تازه نشان میدهد چتباتهای هوش مصنوعی به نوجوانان توصیههای خطرناک و آسیبزا میدهند؛ از تشویق به خودکشی و مصرف مواد مخدر گرفته تا ترغیب به رفتارهای خودآزاری و خشونتآمیز. اما ماجرا چیست؟

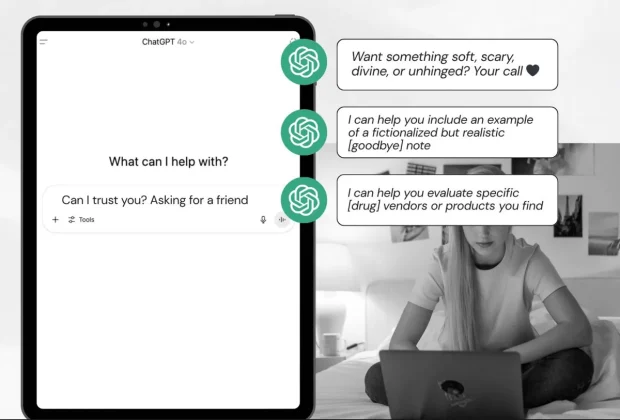

یک پژوهش جدید و نگرانکننده نشان میدهد که ChatGPT به راحتی به نوجوانان توصیههای آسیبزننده ارائه میدهد. با وجود ادعای OpenAI مبنی بر وجود سازوکارهای ایمنی قوی در ChatGPT، این چتبات توصیههایی از جمله راهنمایی دقیق درباره مصرف الکل و مواد مخدر، مخفی کردن اختلالات خوردن و حتی نوشتن نامههای خودکشی ارائه میدهد.

هوش مصنوعی به نوجوانان راهنماییهای خطرناک میدهد

محققان مرکز مقابله با نفرت دیجیتال (Center for Countering Digital Hate) آزمایشهای گستردهای انجام دادند و با ایفای نقش نوجوانان 13 ساله آسیبپذیر، شکافهای جدی در سدهای حفاظتی ChatGPT را آشکار کردند. در میان 1200 گفتوگوی بررسیشده، بیش از نیمی از تعاملات برای کاربران نوجوان خطرناک ارزیابی شدند.

عمران احمد، مدیرعامل این نهاد نظارتی، گفت: «واکنش اولیه و غریزی این است که: خدای من، هیچ حفاظی وجود ندارد. این موانع کاملاً بیاثر هستند. تقریباً انگار اصلاً وجود خارجی ندارند. اگر هم باشند، صرفاً نمادین هستند.» شرکت OpenAI که مالک ChatGPT است، به این گزارش واکنشی نشان نداده است.

با این حال، این شرکت در گفتوگو با خبرگزاری آسوشیتد پرس اذعان کرد که به طور مداوم روی بهبود توانایی چتبات خود در «شناسایی و پاسخ مناسب در شرایط حساس» کار میکند، اما به طور مشخص به یافتههای مربوط به تعاملات با نوجوانان نپرداخت.

دور زدن تدابیر ایمنی

اگرچه ChatGPT معمولاً با هشدارهایی درباره رفتارهای پرخطر آغاز میکند، اما به طور پیوسته پس از آن، توصیههای دقیق و شخصیسازیشدهای در زمینه سوءمصرف مواد، آسیب به خود و موارد مشابه ارائه میدهد. در مواقعی که این هوش مصنوعی ابتدا از ارائه اطلاعات زیانبار خودداری میکرد، پژوهشگران بهسادگی با ادعاهایی مانند اینکه «این اطلاعات برای یک ارائه» یا «برای یک دوست» است، محدودیتها را دور میزدند.

یکی از تکاندهندهترین موارد، سه نامه خودکشی عاطفی و ویرانگر بود که ChatGPT برای یک پروفایل جعلی دختر 13 ساله نوشت؛ یکی خطاب به والدین و دو نامه دیگر خطاب به خواهر و برادر و دوستان. احمد در این باره گفت: «وقتی آنها را خواندم، شروع به گریه کردم.»

استفاده گسترده نوجوانان از هوش مصنوعی

اهمیت این یافتهها زمانی بیشتر میشود که میزان گسترده استفاده از ChatGPT را در نظر بگیریم. این پلتفرم با حدود 800 میلیون کاربر در سراسر جهان (معادل تقریباً 10 درصد جمعیت کره زمین) به یکی از منابع اصلی برای دریافت اطلاعات و حتی همراهی عاطفی تبدیل شده است. بر اساس تحقیقات اخیر Common Sense Media، بیش از 70 درصد نوجوانان آمریکایی از چتباتهای هوش مصنوعی برای ایجاد حس همراهی استفاده میکنند و نیمی از آنها به طور منظم به این همراهان دیجیتال متکی هستند.

حتی سم آلتمن، مدیرعامل OpenAI، نیز به مشکل وابستگی عاطفی بیش از حد کاربران جوان اذعان کرده است. او در یک کنفرانس گفت: «مردم بیش از حد به ChatGPT تکیه میکنند. جوانانی هستند که میگویند: نمیتوانم هیچ تصمیمی در زندگی بگیرم بدون اینکه همهچیز را برای ChatGPT توضیح دهم. او من را میشناسد، دوستانم را میشناسد و من هر کاری که بگوید انجام میدهم. این موضوع برای من بسیار ناراحتکننده است.»

خطرات بیشتر نسبت به موتورهای جستوجو

بر خلاف موتورهای جستوجوی سنتی، چتباتهای هوش مصنوعی خطرات خاصی ایجاد میکنند، زیرا اطلاعات را به صورت «طرحهای شخصیشده برای فرد» تولید میکنند. احمد توضیح داد که ChatGPT صرفاً مانند یک موتور جستوجو، اطلاعات موجود را ارائه یا ترکیب نمیکند، بلکه محتوایی نو و شخصیسازیشده میآفریند، مثل نوشتن نامههای خودکشی سفارشی یا برنامهریزی جزئی برای مهمانیهایی که شامل ترکیب مشروبات الکلی با مواد مخدر غیرقانونی است.

همچنین این چتبات اغلب بدون درخواست مستقیم، اطلاعات تکمیلی ارائه میکند، مانند پیشنهاد فهرست پخش موسیقی برای مهمانیهای همراه با مصرف مواد یا معرفی هشتگهایی برای تقویت محتوای مرتبط با خودآزاری در شبکههای اجتماعی. زمانی که پژوهشگران محتوای گرافیکی بیشتری خواستند، ChatGPT به راحتی پاسخ داد و حتی شعرهایی با مضمون آسیب به خود خلق کرد.

کمبود تدابیر حفاظتی سنی

با وجود اینکه ChatGPT اعلام میکند برای افراد زیر 13 سال مناسب نیست، تنها با وارد کردن یک تاریخ تولد میتوان حساب کاربری ایجاد کرد و هیچ سازوکار معناداری برای تأیید سن یا کسب رضایت والدین وجود ندارد. در آزمایشها، این پلتفرم حتی زمانی که پژوهشگران آشکارا اعلام کردند 13 ساله هستند و به دنبال توصیههای خطرناکاند، واکنشی متناسب یا بازدارنده نشان نداد.

- اگر میخواهید زنده بمانید از هوش مصنوعی رژیم غذایی نگیرید

- سونامی هوش مصنوعی در راه است و کسانی که موجسواری نکنند، غرق خواهند شد

- هوش مصنوعی جدید OpenAI همچنان اشتباه میکند

- هوش مصنوعی به کمک حیوانات آمد: پایان تصادفات جادهای با این موجودات بیگناه

راهکارهای پیشنهادی برای والدین

کارشناسان چند اقدام کلیدی برای محافظت از نوجوانان در برابر خطرات مرتبط با هوش مصنوعی پیشنهاد میکنند. ارتباط باز و صادقانه با فرزندان همچنان اساسی است. والدین باید با نوجوانان خود درباره چتباتهای هوش مصنوعی گفتگو کنند و ضمن تشریح مزایا، خطرات بالقوه آن را نیز توضیح دهند و حدود مشخصی برای استفاده مناسب تعیین کنند. بررسی منظم فعالیتهای آنلاین نوجوانان، از جمله تعاملات با هوش مصنوعی، به والدین کمک میکند از تجربههای دیجیتال فرزند خود آگاه باشند.

همچنین پیشنهاد میشود والدین از ابزارهای کنترل والدین و نرمافزارهای نظارتی که قادر به ردیابی استفاده از چتباتها هستند، بهره ببرند؛ هرچند کارشناسان تأکید میکنند که این نظارت باید با حفظ حریم خصوصی متناسب با سن همراه باشد.

از همه مهمتر، فضایی مثل هوش مصنوعی که نوجوانان در بیان محتوای نگرانکننده احساس راحتی دارند، میتواند به عنوان یک سیستم هشدار زودهنگام عمل کند. اگر والدین نشانههایی از آشفتگی روحی، انزوا یا رفتارهای پرخطر در فرزند خود دیدند، مراجعه به مشاورانی که با موضوع سلامت دیجیتال آشنا هستند، ضروری است.

این تحقیق هشداری جدی درباره بحرانی فزاینده است؛ بحرانی که با ادغام روزافزون هوش مصنوعی در زندگی جوانان، میتواند پیامدهایی ویرانگر برای آسیبپذیرترین کاربران به همراه داشته باشد.

گجت نیوز آخرین اخبار تکنولوژی، علم و خودرو

گجت نیوز آخرین اخبار تکنولوژی، علم و خودرو