روز گذشته گزارشی مبنی بر رفتار دیوانهوار ربات چت بینگ مایکروسافت منتشر شد. حالا این کمپانی توصیه میکند که زیاد از این چت بات استفاده نکنید!

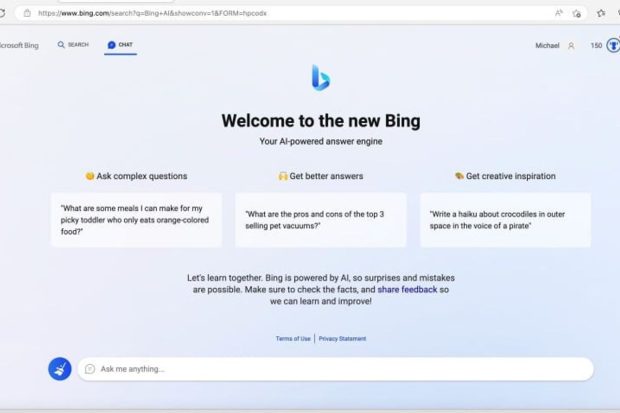

مایکروسافت در پاسخ به گزارشهای اخیر کاربران مبتنی بر رفتارهای نامناسب و نگران کننده ربات چت بینگ، محدودیتهای جدیدی را برای استفاده از این چت بات اعلام کرده است. بر همین اساس، جستجوگر بینگ از این پس میتواند در طول روز حداکثر به ۵۰ پرسش و در ۵ مراجعه پاسخ دهد.

تیم Bing در یک پست وبلاگی توضیح داده که این محدودیت با توجه به اینکه اکثر قریب به اتفاق کاربران فقط ۵ نوبت در روز برای یافتن پاسخهای خود به این ربات مراجعه میکنند و تنها ۱ درصد از مکالمات بیش از ۵۰ پیام دارد، این محدودیتها را روی ربات خود اعمال کردهاند. اگر محدودیت ۵ جلسه جستجو و ۵۰ سوال در روز تمام شود، بینگ پیشنهاد میکند که موضوع مورد نظرتان را جستجو کنید.

اخیراً برخی کاربران از رفتارهای دیوانهوار ربات چت مایکروسافت گلایه کرده بودند. ما در گزارشی مطرح کردیم که این ربات برخی افراد را تهدید به مرگ کرده و یا به افرادی که متأهل هستند، پیشنهاد ازدواج داده است. مایکروسافت حالا متوجه شده که جلسات طولانی چت با بیش از ۱۵ سوال میتواند باعث عملکرد نادرست ربات چت شود و پاسخهای نادرستی به کاربرانش بدهد. این کمپانی حالا امیدوار است با محدود کردن جلسات و پرسشها، بتواند پاسخهای درست و واضحی را به پرسشهای کاربران بدهد. مشخص نیست که آیا این محدودیتهای روزانه، دائمی هستند یا آنکه مایکروسافت پس از مدتی آنها را حذف میکند. همه چیز به بازخوردهای دریافتی از سوی کاربران بستگی خواهد داشت.

رقابت مایکروسافت و گوگل بر سر هوش مصنوعی

غول آمریکایی همچنان به توسعه هوش مصنوعی خود در جستجوگر Bing ادامه میدهد. این کمپانی میخواهد رقیب دیرینه خودش، گوگل را با استفاده از هوش مصنوعی شکست دهد. البته که گوگل هم در آن سمت خبر از توسعه هوش مصنوعی بارد (Bard) داده که بهزودی کاربران میتوانند از آن در موتور جستجوی گوگل استفاده کنند. هرچند که اشتباهات این هوش مصنوعی در روز معارفه، باعث ضرر ۱۰۰ میلیارد دلاری به آلفابت، شرکت مادر گوگل شد.

گجت نیوز آخرین اخبار تکنولوژی، علم و خودرو

گجت نیوز آخرین اخبار تکنولوژی، علم و خودرو