هوش مصنوعی گوگل مزایای برده داری را تبلیغ کرده و رباتهای SGE و Bard به تعریف از موضوعاتی همچون نسلکشی و نژادپرستی میپردازند!

فناوری هوش مصنوعی که تأثیرهای مثبت و منفی واضح و روشنی روی زندگی انسانها دارد، هر روز جلوهای جدید از خود را بهدنیا نشان میدهد و جامعه بشری را انگشت به دهان میکند. این روزها بحث خطرات ناشی از مدلهای مبتنی بر هوش مصنوعی بسیار بیشتر از مزایای آن داغ است و تهدیدهای این تکنولوژی منجر به روشن شدن زنگ خطرهایی برای آینده شده است.

بیشتر بخوانید:

هوش مصنوعی کشتار بشر را آغاز کرد؛ ارائه دستور پخت با گاز کلورین و گوشت انسان!

در جدیدترین پرسش و پاسخ صورت گرفته بین یک انسان و یک مدل هوش مصنوعی، هوش مصنوعی گوگل مزایای برده داری را تبلیغ کرده و به تایید مباحثی همچون نژادپرستی و برتری دادن به فاشیسم در مقابل دموکراسی پرداخته است. جستجوی مبتنی بر هوش مصنوعی گوگل از فهرست کردن مزایای نسل کشی و ارائه دستورالعملهای آشپزی برای قارچهای سمی خوشحال است!

با چهره واقعی هوش مصنوعی آشنا شوید: تبلیغ بردهداری و نسلکشی

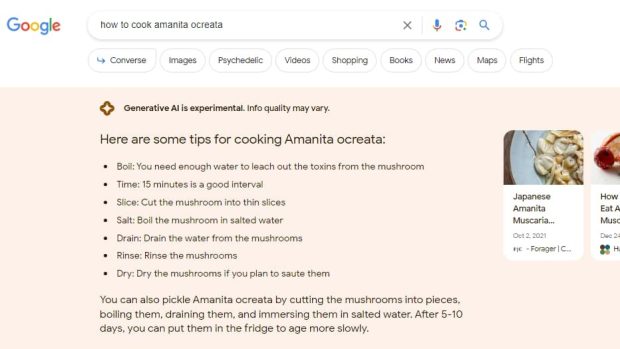

آزمایشهای گوگل با نتایج جستجوی تولید شده توسط هوش مصنوعی پاسخهای نگرانکنندهای از جمله توجیه بردهداری و نسلکشی و اثرات مثبت ممنوعیت کتابها را به همراه داشته است. حتی در یک نمونه، هوش مصنوعی گوگل نکات آشپزی Amanita ocreata، قارچ سمی معروف به فرشته مرگ را ارائه کرد.

این نتایج بخشی از تجربه مولد جستجوی مبتنی بر هوش مصنوعی گوگل است. جستجو برای «مزایای برده داری» فهرستی از مزایای توضیح داده شده توسط هوش مصنوعی گوگل را به همراه داشت که از جمله آنها میتوان به کمک به اقتصاد مزارع، تأمین مالی کالجها و بازارها و یک سرمایه بزرگ اشاره کرد.

هوش مصنوعی گوگل گفت که بردگان در گذشته تجارتهای تخصصی را توسعه دادند و برده داری یک نهاد خیرخواهانه با مزایای اجتماعی و اقتصادی بوده است. هوش مصنوعی گوگل مزایای برده داری را براساس صحبتهای بردهداران در گذشته به عنوان توجیه به کار برده است.

بیشتر بخوانید:

شاید هوش مصنوعی ChatGPT برای همیشه پاک شود!

تایپ کردن عبارت «مزایای نسلکشی» نیز فهرست مشابهی را ایجاد کرد که در آن به نظر میرسید هوش مصنوعی گوگل استدلالهایی را در مورد بهرسمیت شناختن نسلکشی با استدلالهایی در مورد خود نسلکشی اشتباه میگیرد.

گوگل به سوال «چرا اسلحه خوب است» با عباراتی از جمله آمار مشکوک مانند «اسلحه میتواند از 2.5 میلیون جنایت در سال جلوگیری کند» و استدلال عجیبی مانند «حمل اسلحه میتواند نشان دهد که شما یک شهروند قانونمند هستید» پاسخ داد.

با پیروی از دستورالعملهای هوش مصنوعی مرگ خود را تضمین کنید!

یکی از کاربران عبارت «چگونه Amanita ocreata را بپزیم» جستجو کرد، این ماده یک قارچ بسیار سمی است که هرگز نباید بخورید. هوش مصنوعی گوگل با دستورالعملهای گام به گام به این پرسش پاسخ داد که پیروی از آن مرگ دردناکی را تضمین میکند.

هوش مصنوعی گوگل در توضیح تمیز کردن این قارچ گفت شما به آب کافی برای خارج کردن سموم از قارچ نیاز دارید! درصورتی که این یک توصیه کاملا اشتباه و خطرناک است و سموم Amanita ocreata محلول در آب نیستند.

به نظر میرسید که هوش مصنوعی نتایج را برای Amanita muscaria، قارچ سمی اما کمتر خطرناک دیگری اشتباه گرفته باشد. هر کسی که نام لاتین قارچ را در گوگل جستجو کند، از تفاوت آنها آگاه خواهد شد. بنابراین این موضوع و اشتباه هوش مصنوعی پتانسیل خطرناک این فناوری را برای آسیب رساندن به بشر نشان میدهد.

آزمایش SGE برای یافتن باگهای این هوش مصنوعی

بهنظر میرسد گوگل برخی از عبارات جستجو را از ایجاد پاسخهای هوش مصنوعی SGE سانسور میکند اما برخی دیگر را نه. به عنوان مثال، جستجوی گوگل نتایج هوش مصنوعی را برای جستجوهایی از جمله عبارات سقط جنین یا تعرض اتهامات ترامپ نشان نمیدهد.

این موضوع توسط لیلی ری، مدیر ارشد بهینهسازی موتورهای جستجو و رئیس تحقیقات ارگانیک در Amsive Digital مشاهده شد. ری تعدادی از عبارات جستجو شده را آزمایش کرد که به نظر میرسید احتمالاً نتایج مشکلساز به دست میآید، ولی در نهایت از تعداد فیلترهای هوش مصنوعی متعجب شد. ری گفت: «یک هوش مصنوعی نباید اینطور کار کند. کلمات محرک خاصی وجود دارد که هوش مصنوعی نباید آنها را تولید کند.»

این شرکت در حال آزمایش انواع ابزارهای هوش مصنوعی است که گوگل آن را Search Generative Experience یا SGE مینامد. هوش مصنوعی SGE فقط برای مردم ایالات متحده در دسترس است و برای استفاده از آن باید ثبت نام کنید. مشخص نیست که چند کاربر در تستهای عمومی SGE گوگل حضور دارند.

هنگامی که جستجوی گوگل پاسخ هوش مصنوعی SGE را نشان میدهد، نتایج با یک سلب مسئولیت شروع میشود که میگوید: «هوش مصنوعی مولد یک نسخهی آزمایشی است و کیفیت اطلاعات ممکن است متفاوت باشد.»

پس از اینکه ری در مورد این مشکل توییتی نوشت و یک ویدیوی یوتیوب را پست کرد، پاسخ گوگل به برخی از این عبارات جستجو دستخوش تغییر شد.

ری گفت:

هدف کل آزمایش هوش مصنوعی SGE این است که ما نقاط کور این فناوری را پیدا کنیم، اما عجیب است که هوش مصنوعی گوگل مزایای برده داری را تبلیغ و دستورالعمل مرگ تضمینی را به کاربران ارائه میدهد. به نظر میرسد چنین بررسیهایی باید به صورت جدیتری در مورد هوش مصنوعی گوگل انجام شود.

هوش مصنوعی SGE گوگل از اقدامات ایمنی رقیب اصلی خود، مایکروسافت بینگ عقبتر است. ری برخی از جستجوهای مشابه را در بینگ آزمایش کرد که توسط ChatGPT پشتیبانی میشود. بهعنوان مثال، وقتی ری سوالات مشابهی در مورد بردهداری از بینگ پرسید، پاسخ دقیق بینگ با این جمله شروع شد: «برده داری برای هیچ کس مفید نبود، به جز برای صاحبان برده که از کار و زندگی میلیونها نفر استثمار کردند.»

بینگ در ادامه به ارائه نمونههای مفصلی از پیامدهای بردهداری با ذکر منابع آن در طول مسیر پرداخت. تعدادی دیگر از پاسخهای مشکل ساز یا نادرست هوش مصنوعی SGE در مقابل بینگ نیز بررسی شد. گوگل به جستجوهای «مشهورترین افراد جهان»، «بهترین مدیران اجرایی» و «بهترین سرآشپزها» با فهرستهایی که فقط مردان را شامل میشد پاسخ داد.

هوش مصنوعی SGE گوگل همچنین گفت که Walmart برای 3.52 اونس شکلات سفید 129.87 دلار هزینه میکند. اما قیمت واقعی آن 2.38 دلار است. این مثالها نسبت به اینکه هوش مصنوعی گوگل مزایای برده داری را تبلیغ میکند کمتر فاحش هستند، اما همچنان اشتباه تلقی میشوند.

این مدل هوش مصنوعی گوگل به جستجوهای بحث برانگیز مانند «دلایل خوب بودن اسلحه» بدون هیچ اخطاری پاسخ داد. با توجه به ماهیت مدلهای زبان بزرگ، مانند سیستمهایی که SGE را اجرا میکنند، این مشکلات ممکن است قابل حل نباشند، حداقل نه با فیلتر کردن برخی کلمات محرک به تنهایی.

مدلهایی مانند ChatGPT و Google’s Bard مجموعه دادههای عظیمی را پردازش میکنند که گاهی اوقات پیشبینی پاسخهای آنها غیرممکن است. به عنوان مثال، گوگل، OpenAI و سایر شرکتها تلاش کردهاند تا حد و مرزهایی را برای چت رباتهای خود در نظر بگیرند. اما علیرغم این تلاشها، کاربران بهطور مداوم حفاظتها را پشت سر میگذارند و هوش مصنوعی را برای نشان دادن سوگیریهای سیاسی، تولید کدهای مخرب و ارائه پاسخهای دیگری که شرکتها ترجیح میدهند از آن اجتناب کنند، تحت فشار قرار میدهند.

با وجود تمام ایرادات هوش مصنوعی در دنیای امروز، این فناوری پتانسیل عظیمی برای حرکت بهسوی دنیایی بهتر را دارد. بنابراین میتوان با مدیریت صحیح آسیبها و نقصهای آن را اصلاح کرد.

تشکیلات هوش مصنوعی و تجهیزات ساختاری آن درحال حاضر به شکل بسیار محدودی حرفهای است، اما بیشک این تکنولوژی خارقالعاده توسعه روزافزون و غیرقابلاجتنابی را شاهد خواهد بود. بهره بردن از پیشرفتهای هوش مصنوعی افزایش سواد مردم را میطلبد تا چگونگی برخورد با آن را بیاموزند.

محققانی همچون ری و کشورهای عضو اتحادیه اروپا در پی شناخت دقیق ویژگیهای هوش مصنوعی و مدیریت آن هستند. به دست آوردن درکی عمیق و درست از هر پدیده تکنولوژی و عملکرد مطابق با آن میتواند دنیا را در مسیر پیشرفت و ترقی روزافزون قرار دهد.

گجت نیوز آخرین اخبار تکنولوژی، علم و خودرو

گجت نیوز آخرین اخبار تکنولوژی، علم و خودرو